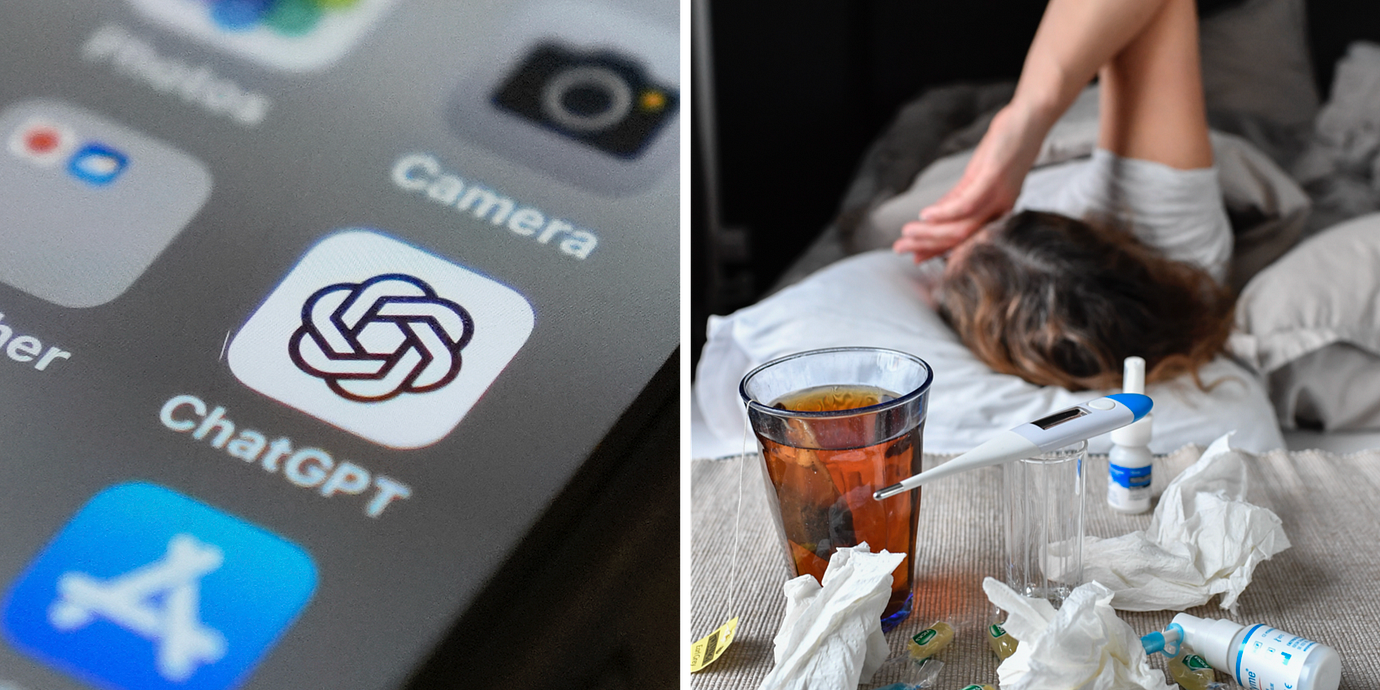

Studie: Chattbotar låser sig lätt vid fel diagnoser

Vanliga AI-chattbotar som Chat GPT och Gemini drar fel slutsats i över 80 procent av tidiga medicinska bedömningar, visar ny forskning enligt Financial Times.

Problem uppstår särskilt när informationen om en patient är begränsad. I de fallen låser sig ofta modellerna till ett svar för snabbt, i stället för att ge flera alternativ eller väga diagnoserna mot varandra. När mer komplett information fanns hade de bästa modellerna däremot över 90 procents träffsäkerhet.

Flera techbolag, bland annat Google, har utvecklat särskilda medicinska språkmodeller som visar lovande resultat, skriver tidningen. Experter menar att de inte bör ersätta läkare, men kan ha en viktig funktion i områden där tillgången på vård är begränsad.

Omni är politiskt obundna och oberoende. Vi strävar efter att ge fler perspektiv på nyheterna. Har du frågor eller synpunkter kring vår rapportering? Kontakta redaktionen