Bedragarnas högteknologiska strategi – klonar din röst

Vad gör du om en familjemedlem eller vän ringer dig och ber om att få låna lite pengar? Är du schysst och för över några hundralappar? Faktum är att du i så fall kan ha blivit lurad.

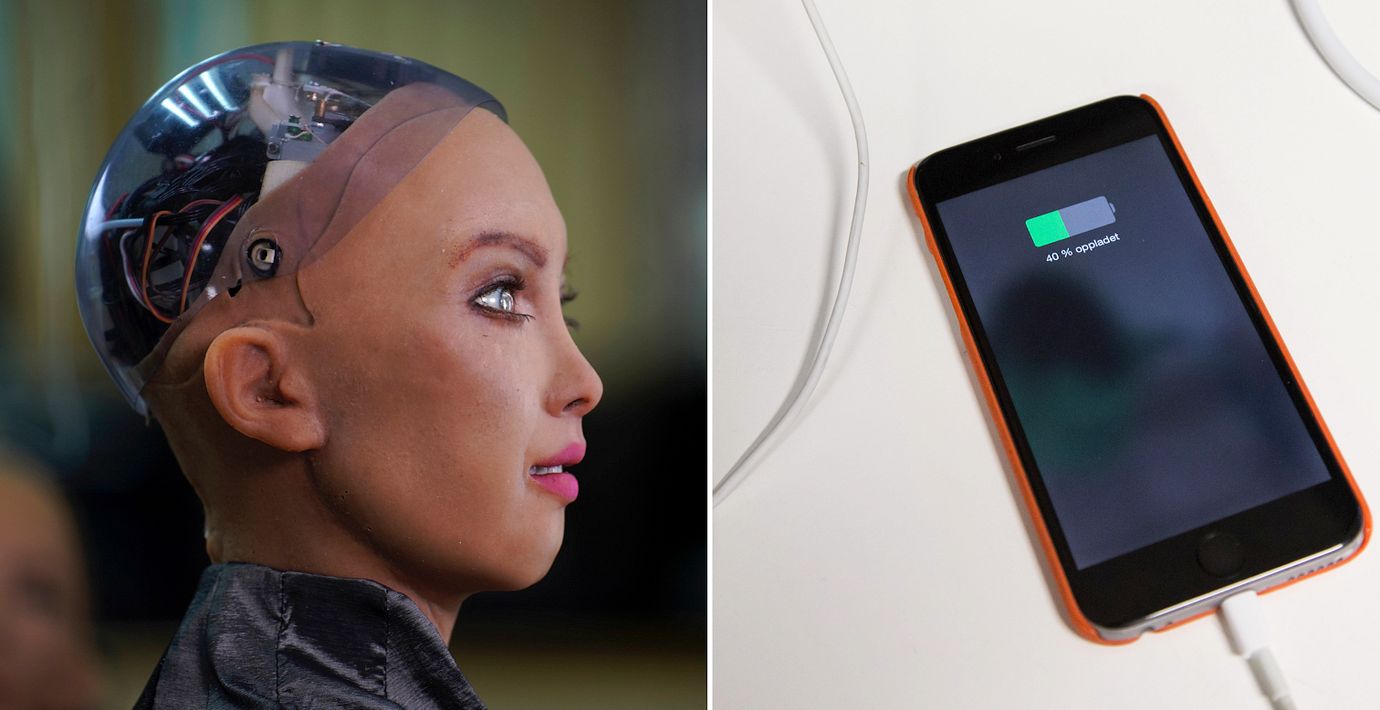

Bedragare har nämligen börjat använda sig av en ny delikat metod för att snärja sina offer, skriver The Verge. Det handlar om konstgjorda röster som tagits fram med hjälp av artificiell intelligens – så kallade deepfakes.

Enligt sajten Motherboard så utsattes en anställd på ett teknikföretag för just ett sådant bedrägeriförsök i juni 2020. Den anställda fick ett meddelande i sin röstbrevlåda från en person som påstod sig vara företagets vd som behövde “omedelbar hjälp att genomföra en brådskande företagsaffär”.

Rösten ska ha låtit “nästan som vd:ns röst” men säkerhetsföretaget NISOS kunde avslöja den som fejk.

– Låter den mer som en robot eller en människa? Jag skulle säga mer som en människa, säger Rob Volkert på NISOS.

Trots att just det här bedrägeriförsöket misslyckades, spås metoden bli allt vanligare framöver. Och ju mer förfinad tekniken blir, desto svårare kommer det att bli att höra skillnad på en riktig röst och en deepfake-röst.

Nyckeln för att bedragarna ska kunna göra så verklighetstrogna röster som möjligt är att få tillgång till så mycket ljud som möjligt från den person vars röst man vill kopiera. Ett arbete som inte är särskilt svårt i dagens digitala samhälle där många samtal och möten spelas in och offentliggörs.

Men hur var det egentligen med påståendet om att det där röstmeddelandet nästan lät som företagets egen vd? Lyssna via länken nedan och avgör själv.